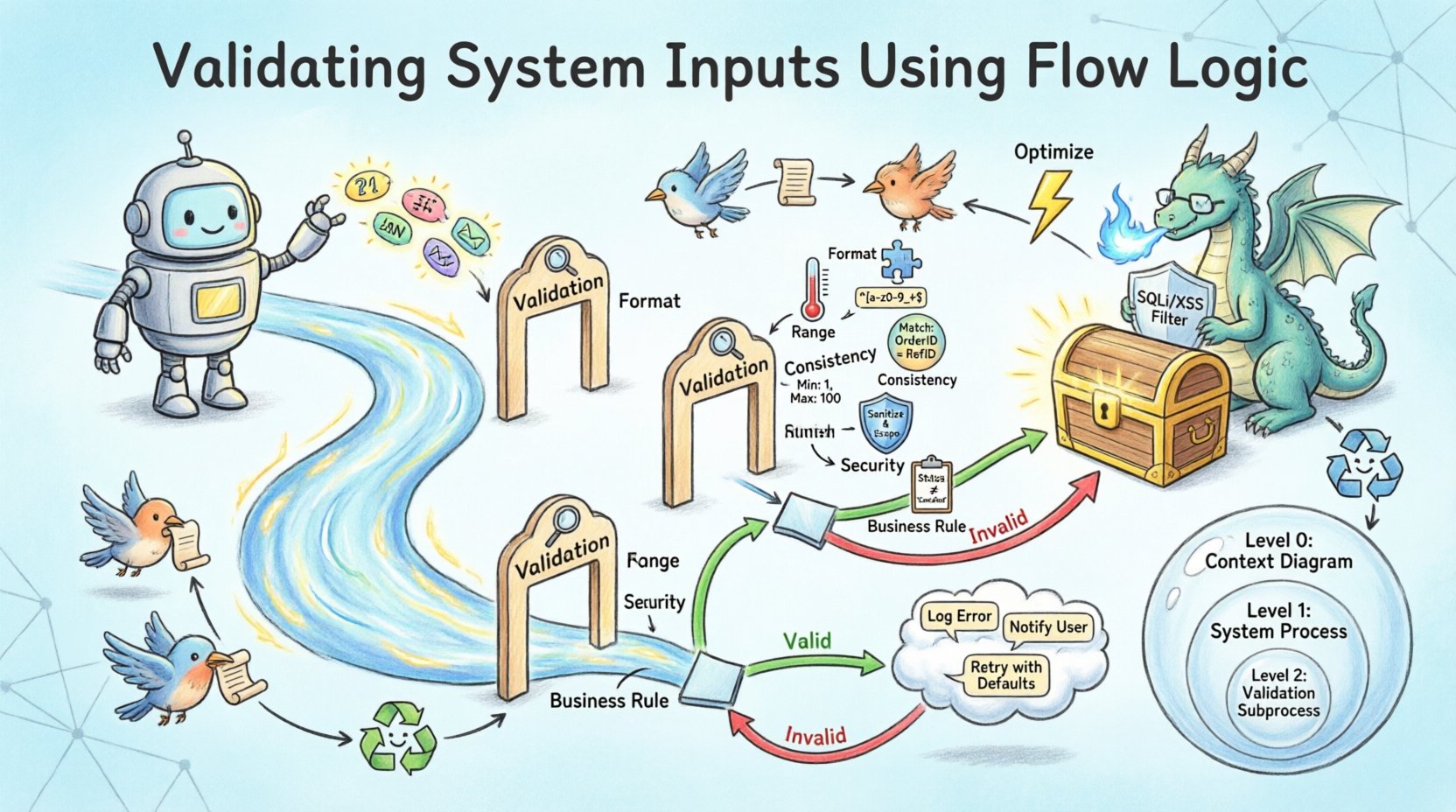

W nowoczesnej architekturze informacji integralność danych stanowi fundament niezawodnego działania systemu. Gdy dane wchodzą w środowisko przetwarzania, niosą ze sobą potencjalne ryzyka, które mogą zakłócić działanie, naruszyć bezpieczeństwo lub zniekształcić wyniki przetwarzania na niższych poziomach. Weryfikacja wejść systemu to nie tylko sprawdzian bezpieczeństwa; jest to podstawowa wymóg logiczny zaimplementowany w samej architekturze systemu. Wykorzystując logikę przepływu w Diagramach Przepływu Danych (DFD), inżynierowie mogą dokładnie określić, gdzie odbywa się weryfikacja, jak obsługiwane są błędy oraz jak dane przechodzą przez architekturę. Ten podejście zapewnia, że każda informacja wprowadzana do systemu spełnia wymagane kryteria zanim wpłynie na logikę biznesową.

Ten artykuł omawia mechanizmy weryfikacji wejść z perspektywy logiki przepływu. Przeanalizujemy sposób wizualnego przedstawienia reguł weryfikacji, sposób struktury punktów decyzyjnych dla akceptacji danych oraz sposób zarządzania stanami błędów bez naruszania przepływu. Zrozumienie tych mechanizmów pozwala architektom tworzyć systemy odpornościowe na niepoprawne dane i zagrożenia zewnętrzne.

Zrozumienie Diagramów Przepływu Danych w kontekście weryfikacji 📊

Diagramy Przepływu Danych zapewniają wizualne przedstawienie, jak informacje poruszają się przez system. Ilustrują one procesy, magazyny danych, jednostki zewnętrzne oraz same dane. W kontekście weryfikacji DFD staje się mapą zaufania. Pokazuje, gdzie dane są odbierane, gdzie są sprawdzane oraz gdzie są przechowywane lub odrzucane.

Standardowy DFD składa się z czterech podstawowych elementów:

- Proces: Przekształcenie danych. To właśnie tutaj zwykle znajduje się logika weryfikacji.

- Magazyn danych: Magazyn, w którym dane są przechowywane. Weryfikacja musi zostać przeprowadzona przed wprowadzeniem danych do magazynu.

- Jednostka zewnętrzna: Źródło lub miejsce docelowe danych poza granicami systemu. Wejście pochodzi stąd.

- Przepływ danych: Ruch danych między elementami. Sprawdzanie poprawności odbywa się wzdłuż tych tras.

Podczas projektowania z uwzględnieniem weryfikacji element Proces staje się kluczowy. Nie wystarczy po prostu przesłać danych z punktu A do punktu B. Proces musi ocenić dane wobec zestawu reguł. W diagramie często przedstawia się to jako specjalny podproces oznaczony jako „Weryfikacja” lub „Oczyszczanie”. Ten sygnał wizualny przypomina programistom, że tutaj istnieje logika służąca do filtrowania danych wejściowych.

Mapowanie logiki weryfikacji na struktury przepływu 🧠

Logika przepływu odnosi się do sekwencji operacji, które określają trasę danych. W kontekście weryfikacji logika ta decyduje, czy dane kontynuują przepływ do kolejnego etapu, czy są kierowane do obsługi błędów. Wdrożenie tego wymaga jasnego zrozumienia punktów decyzyjnych.

Rozważmy formularz wprowadzania danych zbierający informacje użytkownika. Logika przepływu musi zweryfikować następujące atrybuty:

- Obecność: Czy pole jest wypełnione?

- Typ: Czy dane wejściowe mają odpowiedni typ danych (np. liczba całkowita vs. ciąg znaków)?

- Zakres: Czy wartość mieści się w dopuszczalnych granicach?

- Format: Czy ciąg znaków odpowiada wymaganemu wzorcowi (np. adres e-mail)?

W DFD tych sprawdzianów powstają gałęzie. Jeśli dane przejdą wszystkie sprawdzenia, przepływ kontynuuje się do głównego procesu. Jeśli nie powiodą się, przepływ kierowany jest do procesu obsługi błędów. Ta gałęzista struktura jest kluczowa dla solidnej architektury. Bez niej nieprawidłowe dane mogą się rozprzestrzeniać cicho, prowadząc do błędów obliczeniowych lub luk w zabezpieczeniach.

Mechanizm punktów decyzyjnych

Punkty decyzyjne to miejsca, gdzie przepływ się rozdziela. W diagramach logiki przepływu często przedstawia się je jako romb lub specjalny węzeł procesu, który generuje dwa różne przepływy danych: jeden oznaczony jako „Poprawne”, a drugi jako „Niepoprawne”. Przepływ „Poprawne” kontynuuje się do głównego potoku przetwarzania. Przepływ „Niepoprawne” wywołuje odpowiedź błędu lub pętlę korekty.

W diagramie ważne jest rozróżnienie między weryfikacją po stronie klienta a po stronie serwera. Choć weryfikacja po stronie klienta poprawia doświadczenie użytkownika, to weryfikacja po stronie serwera jest prawdziwym strażnikiem. W DFD sprawdzenie po stronie serwera powinno być ostatnią barierą przed tym, jak dane osiągną magazyn danych. Zapewnia to, że nawet jeśli interfejs zostanie obejści, system główny pozostaje chroniony.

Rodzaje reguł weryfikacji danych wejściowych 🛡️

Weryfikacja nie jest pojęciem jednolitym. Obejmuje kilka warstw kontroli. Każda warstwa spełnia inne zadanie i wymaga różnych strategii wdrożenia w logice przepływu.

| Typ weryfikacji | Cel | Przykładowa logika |

|---|---|---|

| Weryfikacja formatu | Zapewnia, że dane odpowiadają oczekiwanemu formatowi | Dopasowanie wyrażeń regularnych do numerów telefonu |

| Weryfikacja zakresu | Zapewnia, że dane mieszczą się w określonych granicach liczbowych | Wiek musi wynosić od 18 do 120 lat |

| Weryfikacja spójności | Zapewnia, że dane są zgodne z innymi danymi wejściowymi | Data zakończenia musi być późniejsza niż data rozpoczęcia |

| Weryfikacja bezpieczeństwa | Zapobiega wstrzyknięciu szkodliwego kodu | Oczyszcza znaczniki HTML w polach tekstowych |

| Weryfikacja reguł biznesowych | Zapewnia, że dane spełniają ograniczenia operacyjne | Rabat nie może przekraczać 50% |

Zintegrowanie tych reguł z logiką przepływu wymaga dokładnego ustawienia kolejności. Weryfikacja bezpieczeństwa powinna zwykle odbywać się na wczesnym etapie procesu, aby zapobiec kosztownemu przetwarzaniu szkodliwych danych. Weryfikacja formatu to zazwyczaj pierwszy krok, który zapewnia poprawność typów danych przed wykonaniem porównań logicznych. Weryfikacja reguł biznesowych często następuje na końcu, ponieważ może zależeć od danych, które już zostały spójnie przetworzone.

Obsługa przepływów błędów i pętli zwrotnej 🔄

Nieprzepuszczalny system nie odrzuca tylko nieprawidłowych danych; zarazem zarządza tym odrzuceniem w sposób zgodny z zasadami. To właśnie tutaj wchodzi w grę gałąź „Nieprawidłowe” w logice przepływu. Przepływ błędów musi prowadzić do mechanizmu informującego użytkownika lub administratora systemu o problemie, bez ujawniania wrażliwych szczegółów wewnętrznych.

W DFD proces obsługi błędów powinien obejmować:

- Rejestrowanie: Zapisuje szczegóły błędu do celów debugowania. Ten przepływ kieruje się do magazynu danych dziennika audytu.

- Powiadomienie: Informuje użytkownika. Ten przepływ kieruje się do jednostki zewnętrznej (interfejs użytkownika).

- Poprawka: Zapewnia mechanizm do poprawy danych. Tworzy to pętlę zwrotną, w której dane powracają do etapu wejściowego.

Pętle zwrotne są kluczowe dla użyteczności. Jeśli użytkownik przesyła formularz z nieprawidłowym adresem e-mail, system powinien pozwolić mu natychmiast go poprawić. W terminach przepływu dane nie opuszczają stałego etapu wejściowego na zawsze. Są ponownie oceniane pod kątem logiki weryfikacji, aż do momentu, gdy przejdą ją, albo użytkownik anuluje działanie. Zapobiega to zamknięciom w ścieżce użytkownika.

Rejestrowanie błędów i śledzenie audytowe

Bezpieczeństwo i zgodność często wymagają zapisania niepowodzeń weryfikacji. Nawet jeśli dane są odrzucane, sam próbny dostęp może być oznaką ataku. Dlatego powinien istnieć osobny przepływ danych z procesu weryfikacji do dziennika audytu. Ten przepływ zapisuje znaczniki czasu, adresy IP źródłowe oraz charakter niepowodzenia. Działa niezależnie od głównego przepływu danych, aby zapewnić, że błędy w rejestrowaniu nie blokują prawidłowego przetwarzania.

Integracja weryfikacji na poziomach procesów 🏗️

Diagramy przepływu danych często istnieją na różnych poziomach abstrakcji. Poziom 0 zapewnia ogólny przegląd, podczas gdy poziomy 1 i 2 rozkładają konkretne procesy. Logika weryfikacji musi być spójna na tych poziomach.

Poziom 0: Granica systemu

Na najwyższym poziomie walidacja jest przedstawiana jako brama. Zewnętrzny element wysyła dane, a system je akceptuje lub odrzuca. Diagram przepływu danych pokazuje granice wejścia i wyjścia. Żadne dane, które nie przejdą walidacji na tym etapie, nie wchodzą do wewnętrznego systemu.

Poziom 1: Rozkład procesów

Podczas rozkładania systemu określone procesy otrzymują podprzepływy walidacji. Na przykład proces „Rejestracja użytkownika” może zostać podzielony na „Sprawdzenie tożsamości”, „Walidacja hasła” i „Weryfikacja kontaktu”. Każdy z tych podprocesów ma własną logikę przepływu. Diagram przepływu danych na tym poziomie pokazuje wewnętrzną przepływność danych wymaganą do przeprowadzenia tych sprawdzeń.

Poziom 2: Szczegółowa logika

Na najniższym poziomie logika jest w pełni zdefiniowana. To właśnie tutaj wyprowadza się rzeczywistą strukturę kodu z diagramu. Logika przepływu tutaj określa dokładną kolejność operacji. Na przykład sprawdzenie, czy nazwa użytkownika istnieje w bazie danych, musi odbyć się przed sprawdzeniem, czy ma poprawny format, aby uniknąć ujawnienia informacji o istniejących użytkownikach.

Optymalizacja wydajności podczas walidacji ⚡

Logika walidacji dodaje obciążenie obliczeniowe. Każde sprawdzenie wymaga czasu przetwarzania. W systemach o dużym obciążeniu nadmierna walidacja może stać się węzłem zawieszenia. Diagram przepływu danych pomaga zidentyfikować miejsca, w których potrzebna jest optymalizacja.

Strategie optymalizacji obejmują:

- Wczesne wyjście: Jeśli podstawowe sprawdzenie nie powiedzie się (np. puste pole), natychmiast zatrzymaj przetwarzanie. Nie uruchamiaj złożonej logiki.

- Buforowanie: Jeśli walidacja zależy od danych zewnętrznych (np. sprawdzanie ID użytkownika w liście zbanowanych kont), buforuj te dane, aby zmniejszyć liczbę wywołań do bazy danych.

- Przetwarzanie asynchroniczne: Dla niekrytycznych walidacji przenieś sprawdzenie do tła. Dzięki temu główny przepływ danych pozostaje szybki.

Gdy przedstawia się te optymalizacje na diagramie przepływu danych, używaj odrębnych przepływów danych dla zadań synchronicznych i asynchronicznych. Pozwala to jasno określić, które walidacje blokują użytkownika, a które działają w tle. Pomaga również w scenariuszach testów obciążeniowych, gdzie konieczne jest zrozumienie zachowania systemu pod ciężkim obciążeniem.

Skutki bezpieczeństwa logiki przepływu 🔒

Nieprawidłowe dane są głównym wejściem do ataków takich jak wstrzyknięcie SQL, przekroczony skrypt międzystronicowy i przepisanie bufora. Logika przepływu zaprojektowana do walidacji działa jak zapora. Jednak projekt musi być poprawny.

Powszechnym wyzwaniem w projektowaniu jest założenie, że dane pochodzą z zaufanego źródła. Na diagramie przepływu danych każdy zewnętrzny element powinien być traktowany jako potencjalnie wrogie. Proces walidacji musi oczyszczać dane przed ich interakcją z bazami danych lub liniami poleceń. To oczyszczanie jest konkretnym węzłem procesu na diagramie.

Dodatkowo logika przepływu musi zapobiegać ujawnianiu informacji. Jeśli błąd walidacji ujawnia, że nazwa użytkownika istnieje, atakujący może wykorzystać to do wyliczania kont. Przepływ błędów powinien dostarczać ogólne komunikaty (np. „Nieprawidłowe dane logowania”), a nie konkretne przyczyny (np. „Nazwa użytkownika nie znaleziona”). Ta subtelność powinna zostać odzwierciedlona w opisie obsługi błędów.

Testowanie i weryfikacja przepływów walidacji ✅

Po zaprojektowaniu logiki przepływu musi zostać zweryfikowana. Testowanie polega na przesyłaniu danych przez ścieżki diagramu przepływu danych, aby upewnić się, że logika działa poprawnie. Często wykonuje się to za pomocą testów jednostkowych dla poszczególnych reguł walidacji oraz testów integracyjnych dla całego przepływu.

Przypadki testowe powinny obejmować:

- Ścieżka pozytywna: Poprawne dane przejdą wszystkie sprawdzenia i dotrą do magazynu danych.

- Przypadki brzegowe: Dane na granicach zakresów (np. wartości minimalne i maksymalne).

- Zepsute dane: Dane z nieprawidłowymi typami lub nieoczekiwanymi znakami.

- Brakujące dane: Dane, w których brakuje wymaganych pól.

Jeśli diagram przepływu danych jest dokładny, wyniki testów powinny zgadzać się z wizualizowanymi przepływami. Jeśli test nie powiedzie się w sposób nieprzewidywany przez diagram, DFD musi zostać uaktualniony. Ten proces iteracyjny zapewnia, że dokumentacja pozostaje wiernym odzwierciedleniem zachowania systemu.

Wnioski dotyczące strukturalnej walidacji 📝

Walidacja danych wejściowych systemu za pomocą logiki przepływu przekształca wymóg bezpieczeństwa w składnik strukturalny architektury. Przy pomocy mapowania reguł walidacji w diagramach przepływu danych zespoły mogą wizualizować, gdzie dane są sprawdzane, jak obsługiwane są błędy i jak informacje przemieszczają się przez system. Ta jasność zmniejsza niepewność, poprawia komunikację między projektantami a programistami i w końcu prowadzi do bardziej stabilnego oprogramowania. Zintegrowanie punktów decyzyjnych, przepływów błędów i sprawdzeń bezpieczeństwa zapewnia, że system pozostaje odporny na nieuniknione zakłócenia zewnętrznej rzeczywistości.

W miarę jak systemy stają się bardziej złożone, zależność od strukturalnej logiki przepływu staje się jeszcze bardziej krytyczna. Stanowi ona szablon do utrzymania integralności danych w czasie. Przestrzegając zasad przedstawionych tutaj, architekci mogą tworzyć przepływy, które nie ufają niczemu i weryfikują wszystko, zapewniając długowieczność i niezawodność ekosystemu danych.