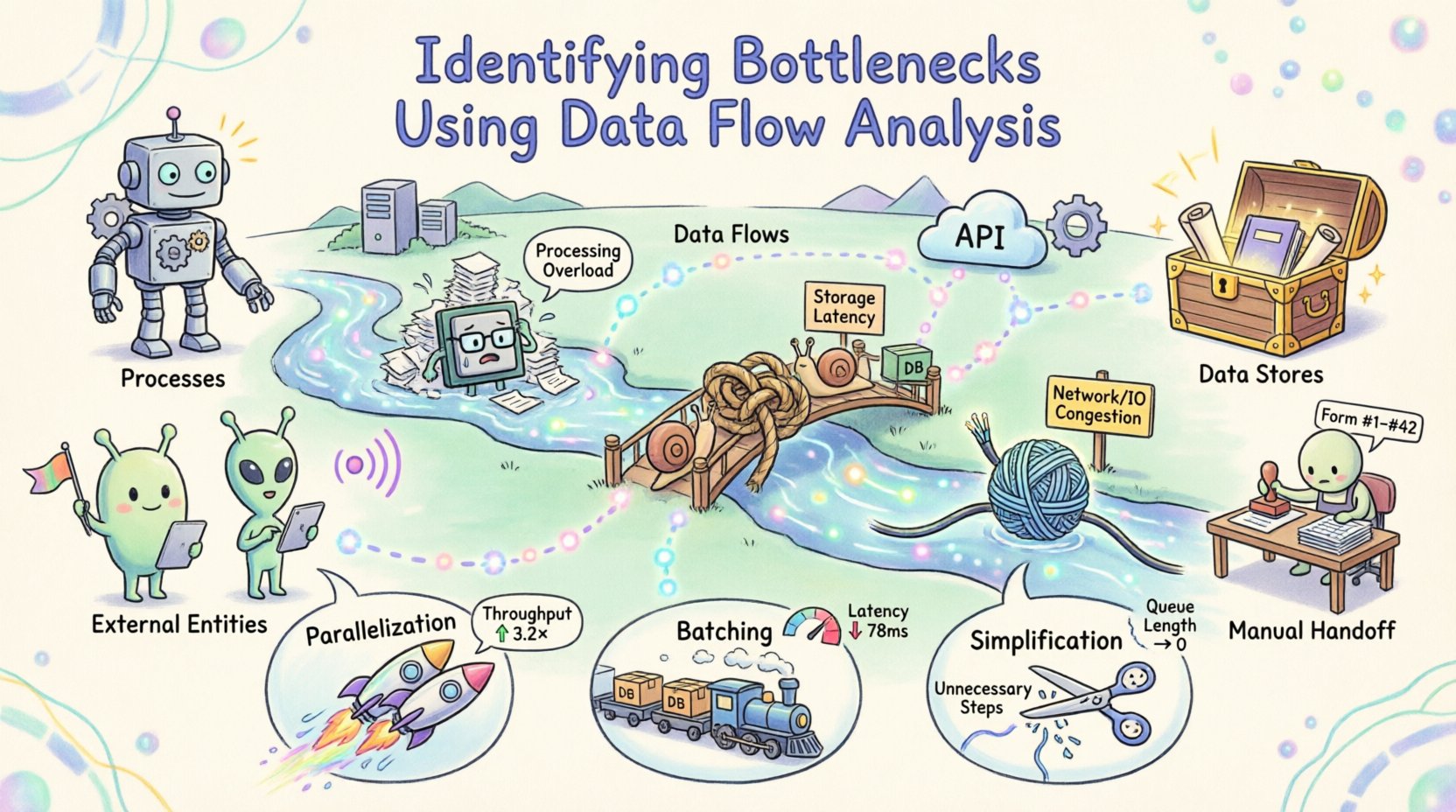

在复杂的系统中,效率并不总是在出现减速之前就能显现。当流程停滞、数据延迟或吞吐量下降时,根本问题通常不在于数据的存储或计算本身,而在于信息的流动。数据流分析提供了一种结构化的方法,用于可视化信息在系统中的流动方式,从而更容易发现摩擦产生的位置。通过绘制这些数据流,团队可以精确定位容量超载或不必要延迟累积的具体位置。 🧭

这种方法需要对系统架构有清晰的理解,而无需依赖专有工具。目标是建立一个逻辑框架,以揭示效率低下之处。无论是在管理软件流水线、制造生产线还是行政工作流程中,这些原则都保持一致。识别这些限制因素后,可以实施有针对性的干预措施,从而在速度和可靠性方面实现可量化的改进。 ⚙️

理解数据流图的基础 🗺️

在定位瓶颈之前,必须先理解这张地图。数据流图(DFD)是信息系统中数据流动的图形化表示。它关注数据的来源、去向以及其变化过程。与展示控制逻辑的流程图不同,DFD强调的是数据元素的流动和转换。

标准DFD中包含四个主要组成部分:

- 处理过程:将输入数据转换为输出数据的转换操作。通常用圆圈或圆角矩形表示。

- 数据存储:数据被保存以供后续使用的地点,例如数据库或文件。

- 外部实体:系统边界之外的来源或目的地,例如用户或其他系统。

- 数据流:数据在各组件之间移动的路径。

创建高层级图可确定范围。低层级图则深入到具体流程。这种层级结构使分析人员能够以不同粒度审视系统。如果在宏观层面出现延迟,放大查看即可揭示导致延迟的具体流程或数据传输环节。 🔍

系统瓶颈的构成 🚦

瓶颈是系统中任何数据流动受限的点,导致积压或延迟。在数据流分析的背景下,瓶颈会以几种不同的方式表现出来。识别约束类型是解决问题的第一步。

| 瓶颈类型 | 描述 | 典型症状 |

|---|---|---|

| 处理 | 计算或逻辑处理时间超过输入数据流的承载能力。 | 处理前队列堆积;CPU或内存使用率急剧上升。 |

| 存储 | 从数据库或文件系统读取或写入数据速度较慢。 | 数据检索期间延迟增加;事务处理时间波动剧烈。 |

| 网络/输入输出 | 组件之间的传输速度受限于带宽或延迟。 | 出现超时;大数据传输频繁暂停。 |

| 人工 | 在本应实现自动化的环节却需要人工干预。 | 任务等待审批;因疲劳或复杂性导致错误发生。 |

理解这些类别有助于优先处理问题。网络限制可能需要基础设施的更改,而处理限制可能需要算法优化。如果没有这种区分,努力可能会被错误地导向那些并不制约系统性能的领域。🛠️

识别方法 🔎

识别瓶颈并非一次性事件,而是一项系统性调查。以下步骤概述了一种稳健的方法,用于分析数据流并定位瓶颈。

1. 绘制当前状态

首先,记录现有的架构。不要依赖记忆或假设。通过访谈利益相关者并查阅文档,来捕捉信息的实际流动情况。创建一个0级图,展示系统的边界和外部交互。然后,创建1级图,将主要流程分解开来。确保每个数据流都有明确的输入和输出。

2. 定义测量指标

可视化图表是定性的。要发现瓶颈,你需要定量数据。为每个流程和数据流选择关键绩效指标(KPI)。相关指标包括:

- 吞吐量: 单位时间内处理的数据量。

- 延迟: 数据从源到目的地传输所需的时间。

- 利用率: 资源处于活动状态的时间百分比。

- 队列长度: 等待处理的项目数量。

在代表性时间段内收集这些数据,可以揭示出规律。一个流程平均看起来很快,但在高峰负载期间可能表现出显著的峰值。这些峰值往往是瓶颈隐藏的地方。📉

3. 分析数据流转

检查流程之间的连接。寻找分支为多条路径或从多个来源合并的数据流。合并点通常会造成竞争。如果三条数据流同时输入到一个处理器,该处理器必须处理合并后的负载。如果容量未相应扩展,就会形成积压。

同样,检查是否存在循环。数据反复回流到某个流程,通常表明存在返工或错误处理。过度循环会消耗资源但不增加价值。追踪这些循环,以判断它们是必要的,还是糟糕设计的结果。🔄

4. 与资源使用情况相关联

将数据流指标与系统资源进行映射。高数据流流量应与高资源使用率相关联。如果某个特定数据流表现出高延迟,但其他地方资源使用率较低,问题可能仅存在于该路径。相反,如果所有流程同时变慢,问题可能是系统性的,例如共享数据库锁或网络拥塞。

使用监控工具同时跟踪资源消耗和数据流。这种关联有助于区分逻辑瓶颈(设计不佳)和物理瓶颈(硬件限制)。⚖️

量化约束的影响 📊

一旦识别出潜在的瓶颈,就必须量化其影响。这一步确保资源被分配到最关键的问题上。并非所有延迟都同等重要。用户界面的延迟可能比后台报表生成的延迟更具破坏性。

计算延迟的成本。这包括估算每次交易损失的时间,并乘以交易总量。例如,如果一个流程额外耗时100毫秒,且每小时处理10,000次交易,那么总损失时间将非常显著。如果这种延迟影响用户体验,业务成本会更高。

考虑连锁效应。管道起始处的延迟可能会向下游传播。如果第一步延迟,所有后续步骤都会被推迟。这会放大总体影响。识别根本原因可以避免只处理症状。修复第一步通常能自动解决下游的延迟问题。🌊

优化策略 🛠️

在识别并量化瓶颈后,重点转向优化。策略取决于约束的性质。主要有三个可操作的杠杆:并行化、批处理和简化。

并行化

如果一个流程受限于计算能力,将工作拆分到多个资源上可以提高吞吐量。这通常适用于独立任务。如果数据流允许拆分,应合理分配负载。确保同步开销不会抵消收益。当任务之间不依赖彼此的即时输出时,并行化效果最佳。🚀

批处理

如果约束与I/O或网络延迟有关,批量处理数据比逐个处理更高效。这可以减少连接打开和关闭的开销。然而,批处理会增加单个项目的延迟。需在吞吐量提升与用户可接受的延迟之间取得平衡。📦

简化

通常,最有效的优化是去除不必要的步骤。检查数据流中是否存在冗余转换。如果数据从一种格式转换为另一种,然后再转回,中间步骤可能可以移除。简化逻辑以减少处理时间。流程中的每一步都会引入潜在的故障点和延迟。✂️

持续监控与迭代 🔄

优化不是终点。系统会不断演进,随着流量模式的变化,新的瓶颈也会出现。一旦初始分析完成并实施改进措施,循环便重新开始。建立定期审查数据流的惯例。

为之前定义的指标设置警报。如果吞吐量下降或延迟飙升,立即启动调查。保持DFD文档的更新。当系统发生变化时,及时更新图表。过时的图表会导致错误的假设和无效的努力。 📝

鼓励持续改进的文化。团队应被赋予报告日常工作中发现的低效问题的权力。一线用户常常能发现高层指标所忽略的瓶颈。他们的反馈对于优化分析至关重要。 👥

案例研究:通用工作流优化 🏭

设想一个场景:在高峰时段,订单处理系统出现了延迟。初步分析显示,订单验证步骤耗时过长。DFD揭示出,验证需要对三个不同的外部系统分别进行独立检查。

通过分析流程,团队发现这些检查是按顺序执行的。将设计改为并行执行这些检查,使总验证时间减少了60%。数据流图也相应更新以反映这一新结构。监控结果证实,积压任务清除得更快,系统在高峰负载下无需人工干预即可正常运行。此案例展示了流程结构的调整如何带来立竿见影的效果。 ✅

可持续效率的最佳实践 🌱

为了保持系统的健康运行,请遵循以下准则:

- 保持图表最新: 一张过时的地图比没有地图更糟糕。

- 关注流程,而不仅仅是功能: 确保数据流动顺畅,而不仅仅是功能正常。

- 测量一切: 如果没有测量,就无法改进。

- 定期审查: 安排对数据架构的定期审计。

- 记录假设: 记录为何某些流程被设计成特定方式,以帮助未来的故障排查。

通过将数据流视为关键资产,组织可以确保其系统始终保持响应性和可靠性。识别瓶颈的过程并非寻找错误,而是深入理解系统。这种理解将带来系统的韧性与性能提升。 🛡️

关于数据流完整性的最后思考 🧩

任何系统的效率都依赖于信息的顺畅流动。当数据遇到阻力时,整个操作都会变慢。数据流分析提供了一个清晰的视角,帮助我们识别阻力发生的位置。通过绘制、测量和调整流程,团队可以消除摩擦,提升性能。

此处描述的技术为可持续优化提供了框架。它们需要纪律和对细节的关注,但回报是系统在压力下仍能保持稳定运行。随着数据量的增长,管理数据流的能力变得愈发关键。掌握这一 discipline 能确保架构的长期稳定与可靠。 🏆