Landscape cyfrowy się zmienia. Interfejsy nie są już ograniczone tylko do ekranu. Użytkownicy oczekują płynnych interakcji, które łączą polecenia głosowe z odpowiedzią wizualną. Ta ewolucja definiujeprojekt UX wielomodalny, w którym elementy dźwiękowe i wizualne działają w concert, a nie izolowane. W miarę postępu, zrozumienie sposobu integracji tych modalności staje się kluczowe do tworzenia intuicyjnych, dostępnych i skutecznych doświadczeń cyfrowych.

Ten przewodnik bada mechanizmy, zasady i wyzwania związane z łączeniem projektu dźwiękowego i wizualnego. Przeanalizujemy, jak zrównoważyć informacje dźwiękowe i wizualne, aby zmniejszyć obciążenie poznawcze i zwiększyć satysfakcję użytkownika. Niezależnie od tego, czy projektujesz dla urządzeń mobilnych, smart speakerów czy systemów w samochodzie, podstawowe zasady integracji pozostają niezmienne.

Zrozumienie interakcji wielomodalnej 🔄

Interakcja wielomodalna odnosi się do systemów, które akceptują wiele rodzajów danych wejściowych i zapewniają wiele rodzajów danych wyjściowych. W kontekście projektu dźwiękowego i wizualnego oznacza to, że użytkownik może wygłosić polecenie, jednocześnie patrząc na ekran. System musi przetworzyć dane dźwiękowe i przedstawić kontekst wizualny, aby potwierdzić działanie lub dostarczyć odpowiedź.

Gdy modalności są dobrze zintegrowane, wzajemnie się wzmacniają. Gdy się sprzeczają, użytkownicy doświadczają trudności. Oto podstawowe elementy tej integracji:

- Modalność wejściowa: Metoda używana do dostarczania danych, np. rozpoznawanie mowy lub dotyk.

- Modalność wyjściowa: Metoda używana do prezentowania wyników, np. tekst, grafika lub syntetyzowany głos.

- Zdolność do rozpoznawania kontekstu: Zdolność systemu do rozumienia środowiska i stanu użytkownika, aby określić, którą modalność należy wyróżnić.

- Spójność: Zapewnienie, że odpowiedź dźwiękowa dokładnie odpowiada stanowi wizualnemu.

Wyobraź sobie sytuację, w której użytkownik prosi o aktualizacje pogodowe. Interfejs wyłącznie dźwiękowy mógłby powiedzieć: „Za dwa dni będzie deszczowo.” Interfejs wyłącznie wizualny mógłby pokazać ikonę chmury. Interfejs wielomodalny powinien powiedzieć te same słowa, jednocześnie wyróżniając ikonę deszczu na ekranie. Ta nadmiarowość wspomaga pamięć i zrozumienie.

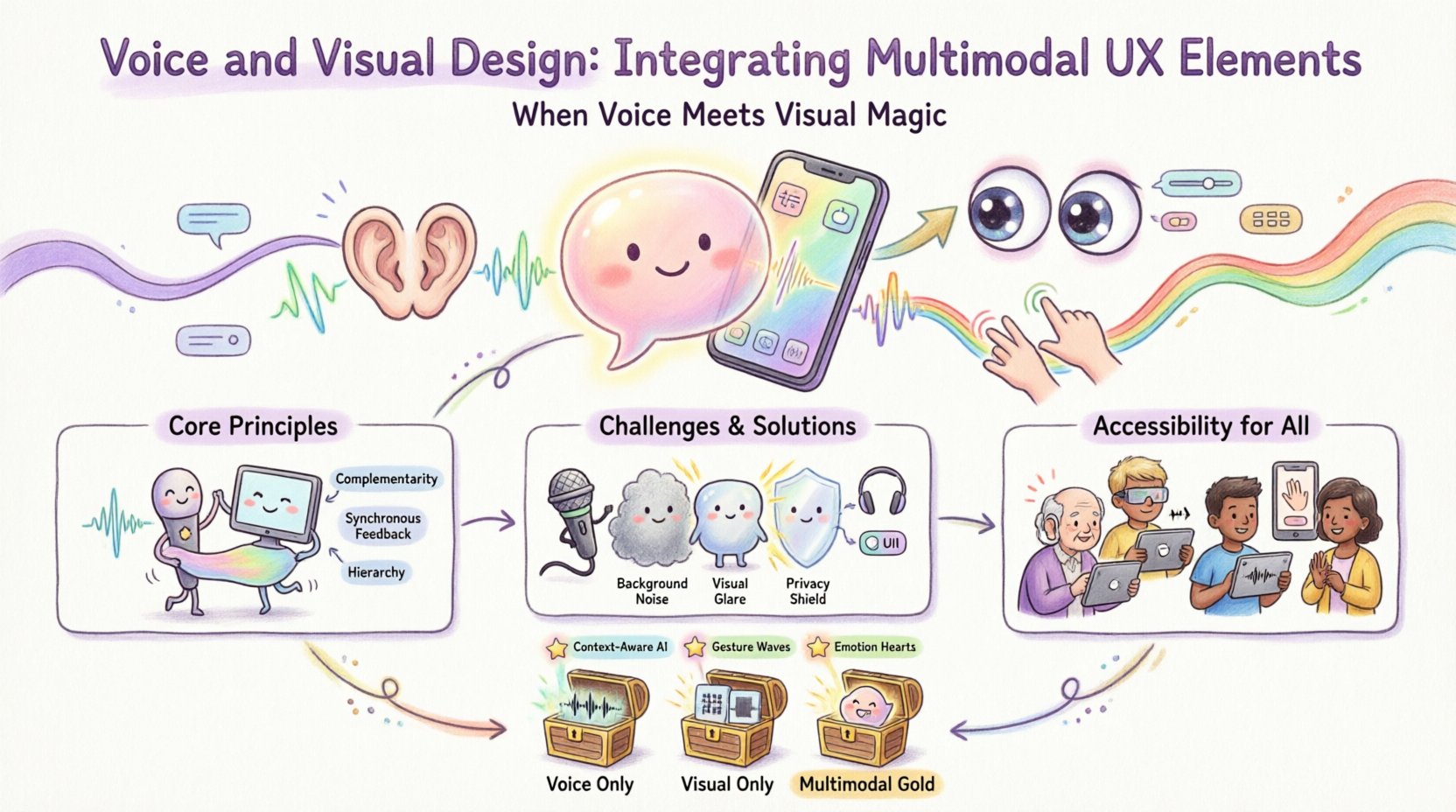

Podstawowe zasady integracji 🛠️

Tworzenie spójnego doświadczenia wymaga przestrzegania określonych zasad projektowych. Te zasady pomagają utrzymać jasność i zapobiegać zamieszaniu między tym, co mówi się, a tym, co widać.

1. Komplementarność zamiast powtarzania

Choć nadmiarowość może być pomocna pod kątem dostępności, powtarzanie dokładnie tej samej informacji w formacie dźwiękowym i wizualnym może wydawać się robotyczne. Zamiast tego dąż do komplementarności. Użyj jednej modalności do podstawowych danych, a drugiej do kontekstu lub nawigacji.

- Wizualna: Wyświetlanie złożonych wykresów, map lub list.

- Dźwiękowa: Podsumowanie kluczowego wniosku lub podanie kolejnego kroku.

Takie podział pracy szanuje pojemność uwagi użytkownika. Jeśli ekran jest zajęty danymi, głos powinien być krótki. Jeśli głos czyta listę, ekran powinien wyświetlać elementy, aby śledzić postęp.

2. Synchroniczna odpowiedź

Opóźnienie jest wrogiem zaufania w interakcji wielomodalnej. Gdy użytkownik mówi, odpowiedź wizualna musi pojawić się w oczekiwanej chwili. Jeśli system nasłuchuje, pokaż wizualny wskaźnik. Jeśli system przetwarza dane, pokaż stan ładowania. Jeśli system jest gotowy na następne polecenie, podaj jasny sygnał.

Opóźnienia między wygłoszonym poleceniem a odpowiedzią wizualną powodują dysonans poznawczy. Użytkownicy mogą się zastanawiać, czy system ich usłyszał, czy interfejs jest uszkodzony. Synchronizacja buduje zaufanie.

3. Hierarchia i skupienie

Nie wszystkie informacje są równe. W interfejsie wielomodalnym musisz zdecydować, która modalność ma podstawowe znaczenie. Głos jest doskonały do kierowania uwagi. Wizualny jest doskonały do szczegółowych odniesień.

Na przykład w zadaniu nawigacji:

- Głos: „Zwrot w lewo za 500 metrów.”

- Wizualnie: Strzałka wskazująca w lewo na mapie.

Głos kieruje natychmiastową czynnością, podczas gdy wizualizacja zapewnia kontekst przestrzenny. Ta hierarchia zapobiega potrzebie przetwarzania dwóch strumieni sprzecznych instrukcji.

Wyzwania w projektowaniu wielomodalnym ⚠️

Projektowanie dla dwóch kanałów jednocześnie wprowadza konkretne trudności. Te wyzwania wahają się od ograniczeń technicznych po psychologię ludzką.

Obciążenie poznawcze

Ludzie mają ograniczoną zdolność przetwarzania informacji. Dodanie warstwy wizualnej do interakcji głosowej może przeciążyć użytkownika. Jeśli użytkownik musi czytać ekran podczas słuchania dźwięku, może pominąć sygnały słowne. To szczególnie prawdziwe w środowiskach stresowych, takich jak jazda samochodem lub obsługa maszyn.

Rozwiązania obejmują:

- Minimalizowanie tekstu na ekranie podczas zadań z dużym udziałem głosu.

- Używanie ikon zamiast słów tam, gdzie to możliwe.

- Zezwalanie użytkownikom na włączanie lub wyłączanie wizualnej odpowiedzi.

Czynniki środowiskowe

Nie wszystkie środowiska są odpowiednie dla głosu. Głośny biuro, zatłoczona ulica lub cichy biblioteka stawiają różne ograniczenia. Podobnie warunki oświetlenia wpływają na użyteczność wizualną. Projekt musi być wystarczająco wytrzymały, by radzić sobie z tymi zmianami.

Adaptacyjne interfejsy wykrywają środowisko i przesuwają równowagę modalności. W głośnym pomieszczeniu system może domyślnie korzystać z potwierdzenia wizualnego. W ciemności może bardziej polegać na sygnałach dźwiękowych.

Prywatność i bezpieczeństwo

Polecenia głosowe często dotyczą wrażliwych danych. Wyświetlanie tych danych na publicznym ekranie może stanowić ryzyko bezpieczeństwa. Z kolei ukrywanie całej odpowiedzi na urządzeniu tylko głosowym może prowadzić do nieuprawnionego dostępu.

Dizajnerzy muszą zaimplementować:

- Ekrany prywatności, które rozmywają dane wizualne, gdy aktywne jest polecenie głosowe.

- Bezpieczna autoryzacja głosowa przed ujawnieniem wrażliwych informacji.

- Jasne wizualne wskaźniki, gdy mikrofon jest aktywny.

Dostępność i inkluzja ♿

Projektowanie wielomodalne nie dotyczy tylko wygody; jest koniecznością dla dostępności. Użytkownicy z różnymi możliwościami wymagają różnych sposobów interakcji z produktami cyfrowymi. Integracja elementów głosowych i wizualnych tworzy wiele dróg do tego samego celu.

Wsparcie dla zaburzeń wzroku

Dla użytkowników, którzy nie mogą zobaczyć ekranu, głos jest głównym kanałem. Jednak czytniki ekranu często mają trudności z treścią dynamiczną. Wielomodalny podejście zapewnia, że aktualizacje wizualne są również ogłaszane przez dźwięk. Z kolei dla użytkowników, którzy nie słyszą, sygnały wizualne muszą pełnić całą funkcję interakcji.

Wsparcie dla zaburzeń słuchu

Użytkownicy, którzy nie słyszą, potrzebują jasnych wizualnych transkrypcji poleceń głosowych. Obejmuje to:

- Napisy w czasie rzeczywistym dla mówionych odpowiedzi.

- Wizualne potwierdzenie rozpoznanych poleceń.

- Jasne wizualne alternatywy dla akcji tylko głosowych.

Zgodność z WCAG

Standardowe wytyczne dostępności, takie jak Wytyczne do Dostępu do Treści Webowej (WCAG), zapewniają ramy dla projektowania wielomodalnego. Kluczowe wymagania obejmują:

- Uchwytne:Zawartość musi być prezentowana w sposób, który użytkownicy mogą odczuć.

- Dostępne do użycia:Elementy interfejsu muszą być używane różnymi metodami.

- Zrozumiałe:Informacje i działanie muszą być zrozumiałe.

- Wytrzymałe:Zawartość musi być wystarczająco wytrzymała dla technologii wspomagających.

Testowanie i weryfikacja 🧪

Weryfikacja interfejsu wielomodalnego wymaga innego podejścia niż testowanie systemów jednomodalnych. Musisz testować interakcję między modalnościami, a nie tylko same modalności.

Scenariusze testów użytkowników

Przeprowadzaj testy w różnych środowiskach, aby symulować rzeczywiste użycie. Obserwuj, jak użytkownicy przechodzą między głosem a dotykiem. Zanotuj, gdzie się mylą lub frustrują.

- Scenariusz A:Ciche środowisko. Testuj używanie tylko głosem.

- Scenariusz B:Głośne środowisko. Testuj wizualne zabezpieczenie.

- Scenariusz C:Wysokie stresy. Testuj szybkość odpowiedzi.

Metryki sukcesu

Śledź konkretne metryki, aby ocenić wydajność:

- Wskaźnik ukończenia zadania:Czy użytkownik ukończył zadanie przy użyciu przepływu wielomodalnego?

- Wskaźnik błędów:Jak często system nie rozumiał wejścia?

- Czas odpowiedzi:Ile czasu zajęło przetworzenie żądania?

- Subiektywne zadowolenie:Czy użytkownik uznał doświadczenie za naturalne?

Porównanie trybów interakcji 📊

Aby lepiej zrozumieć, gdzie każdy tryb pasuje, rozważ poniższe porównanie interakcji głosowych, wizualnych i połączonych.

| Cecha | Tylko głos | Tylko wizualne | Wielostrumieniowy (połączony) |

|---|---|---|---|

| Gęstość informacji | Niska | Wysoka | Zrównoważona |

| Możliwość działania bez użycia rąk | Tak | Nie | Częściowa |

| Prywatność | Niska (publiczna) | Wysoka (ekran) | Średnia |

| Dostępność | Wysoka dla słuchu | Wysoka dla wzroku | Maksymalna |

| Złożoność | Prosta | Złożona | Dynamiczna |

Przyszłe trendy w dziedzinie wielostrumieniowego UX 🚀

Dziedzina szybko się rozwija. Wraz z poprawą technologii granica między głosem a wizualnością będzie się dalej rozmywać. Oto trendy, na które warto zwrócić uwagę.

Systemy świadome kontekstu

Przyszłe interfejsy będą przewidywać potrzeby na podstawie lokalizacji, czasu i historii użytkownika. System może zaproponować polecenie głosowe jeszcze przed tym, gdy użytkownik je nawet nie zada, wyświetlając opcję na ekranie.

Integracja gestów

Poza głosem i dotykiem gesty rąk stają się trzecim trybem interakcji. Połączenie gestów z głosem tworzy bardzo wyrazistą interakcję. Na przykład machnięcie ręką, aby odrzucić powiadomienie, jednocześnie mówiąc „Gotowe.”

Rozpoznawanie emocji

Systemy zaczną wykrywać emocje użytkownika na podstawie tonu głosu i wyrazu twarzy. Jeśli użytkownik brzmi rozdrażniony, system może przełączyć się na bardziej zwięzłą wizualną podsumowanie zamiast długiego wyjaśnienia słownego.

Lista wdrożenia ✅

Zanim uruchomisz produkt wielomodalny, przejrzyj tę listę kontrolną, aby zapewnić jakość i spójność.

- Zdefiniuj główne cele: Czy interakcja ma głównie na celu szybkość, szczegółowość czy dostępność?

- Zaprojektuj przepływ: Stwórz schematy pokazujące, jak zmieniają się stany głosowe i wizualne razem.

- Zdefiniuj obsługę błędów: Co się dzieje, gdy głos nie działa? Co się dzieje, gdy ekran jest ciemny?

- Testuj na różnych urządzeniach: Upewnij się o spójności na urządzeniach mobilnych, stacjonarnych i inteligentnych wyświetlacach.

- Przejrzyj dostępność: Zweryfikuj zgodność z obowiązującymi standardami.

- Monitoruj wydajność: Śledź opóźnienia i stopy błędów po uruchomieniu.

Projektowanie interakcji naturalnych 🗣️

Ostatecznym celem projektowania wielomodalnego jest uczynienie technologii niewidzialną. Użytkownicy nie powinni myśleć o trybie; powinni skupiać się na swoim zadaniu. Wymaga to głębokiego zrozumienia zachowań ludzkich.

Podczas projektowania dialogu:

- Utrzymuj język prosty i bezpośredni.

- Unikaj żargonu technicznego w podpowiedziach głosowych.

- Upewnij się, że tekst wizualny dokładnie odpowiada słowom wymówionym.

- Daj jasne wskazówki, kiedy mówić.

Podczas projektowania układu wizualnego:

- Używaj wysokiego kontrastu dla czytelności.

- Umieść kluczowe informacje w centrum uwagi.

- Animuj przejścia, aby pokazać zmiany stanu.

- Upewnij się, że cele dotykowe są wystarczająco duże, aby uniknąć błędów spowodowanych dużym palcem.

Ostateczne rozważania dotyczące integracji 🤝

Integracja projektowania głosowego i wizualnego to skomplikowane przedsięwzięcie wymagające starannego planowania i ciągłego testowania. Nie wystarczy po prostu dodać mikrofonu do ekranu. Oba muszą działać jako zintegrowany system.

Skupiając się na uzupełnianiu, spójności i dostępności, projektanci mogą tworzyć doświadczenia, które są wytrzymałe i przyjazne dla użytkownika. Przyszłość interakcji leży w tej połączeniu. W miarę postępu, najlepsze interfejsy będą tymi, które dostosowują się do użytkownika, a nie wymuszają użytkownika, by dostosował się do interfejsu.

Pamiętaj, by stawiać potrzeby użytkownika wyżej niż nowoczesność technologiczna. Jeśli interfejs wizualny jest bardziej przejrzysty, użyj go. Jeśli polecenie głosowe jest szybsze, użyj tego. Celem jest efektywność i satysfakcja. Poprawnie podejrzewając, projekt wielomodalny może zmienić sposób, w jaki ludzie interakcjonują z technologią każdego dnia.

Kluczowe wnioski 📝

- UX wielomodalny łączy elementy głosowe i wizualne, aby zapewnić bogatszą interakcję.

- Uzupełnianie zapewnia, że każda modalność dodaje unikalną wartość bez nadmiaru.

- Dostępność jest podstawowym wymaganiem, a nie pożądanej dodatkową funkcją.

- Testowanie musi obejmować różne środowiska i stany użytkownika.

- Spójność między dźwiękiem a wizualnym odzewem buduje zaufanie.