Die Bewertung der Qualität eines objektorientierten Designs ist eine entscheidende Fähigkeit für jeden Softwarearchitekten oder Entwickler. Eine gut strukturierte Architektur stellt sicher, dass die Software über die Zeit hinweg wartbar, skalierbar und an veränderte Anforderungen anpassbar bleibt. Im Bereich der objektorientierten Analyse und Design (OOAD) verschiebt sich der Fokus von der bloßen Funktionsfähigkeit des Codes hin zu einer Codequalität, die langfristig stabil ist.gut. Dieser Leitfaden bietet einen umfassenden Rahmen zur Beurteilung der Designqualität, ohne auf Hype oder Abkürzungen zurückzugreifen.

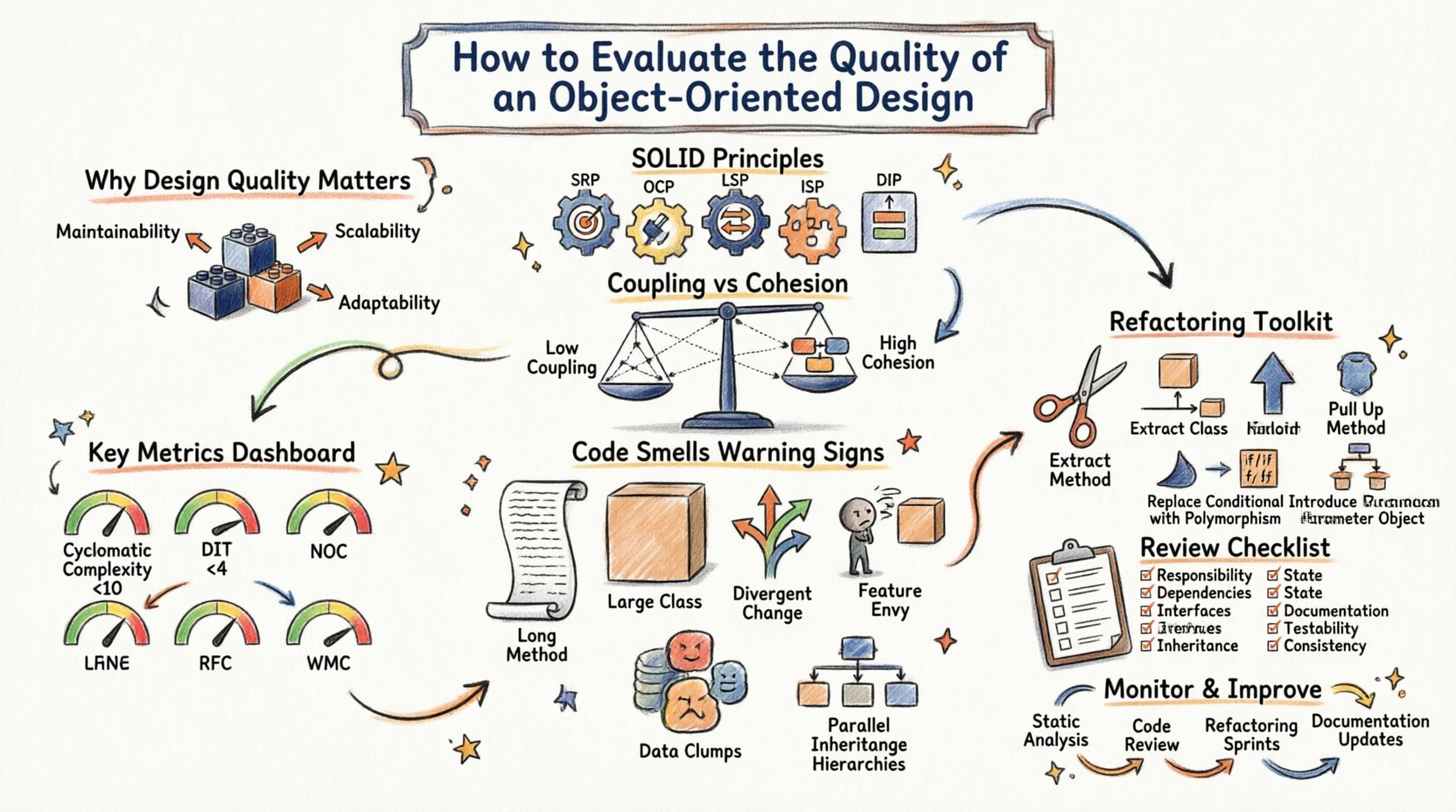

Warum die Designqualität wichtig ist 🏗️

Code wird weitaus häufiger gelesen als geschrieben. Wenn ein objektorientiertes System schlecht gestaltet ist, verbringen Entwickler viel Zeit mit Debugging, Refactoring oder der Vermeidung bestimmter Funktionen aufgrund struktureller Komplexität. Eine hohe Designqualität verringert die kognitive Belastung für das Team. Sie schafft ein System, bei dem Änderungen in einem Bereich nur minimale, vorhersehbare Auswirkungen auf andere Bereiche haben.

Die Bewertung geht nicht nur darum, Fehler zu finden; es geht darum, zukünftigen Aufwand vorherzusagen. Eine robuste Architektur antizipiert Veränderungen. Sie trennt die Verantwortlichkeiten, sodass die Geschäftslogik sich entwickeln kann, ohne die zugrundeliegende Infrastruktur zu beschädigen. Wenn Sie ein Design bewerten, auditieren Sie im Wesentlichen die langfristige Gesundheit des Softwareprodukts.

Die zentralen Säulen des objektorientierten Designs 🧱

Um die Qualität effektiv bewerten zu können, müssen Sie die grundlegenden Prinzipien verstehen, die eine gute Architektur leiten. Diese Prinzipien dienen als Maßstab, an dem Sie Ihr System messen. Obwohl es viele Muster gibt, sind einige zentrale Konzepte unverzichtbar für eine hochwertige Architektur.

1. Die SOLID-Prinzipien ⚙️

Die Abkürzung SOLID steht für fünf Prinzipien, die Wartbarkeit und Flexibilität fördern. Jeder Buchstabe steht für eine spezifische Richtlinie, die, wenn sie befolgt wird, zu besseren Klassenstrukturen führt.

- Einzelverantwortlichkeitsprinzip (SRP):Eine Klasse sollte genau einen Grund haben, sich zu ändern. Wenn eine Klasse sowohl Datenbankoperationen als auch Benutzeroberflächenlogik verwaltet, verstößt sie gegen dieses Prinzip. Eine hohe Kohäsion innerhalb einer Klasse ist ein wesentlicher Indikator für die Einhaltung des SRP.

- Prinzip der Offenheit/Geschlossenheit (OCP):Software-Entitäten sollten für Erweiterungen offen, aber für Änderungen geschlossen sein. Sie sollten neue Funktionalität hinzufügen können, ohne bestehenden Quellcode zu verändern. Dies wird oft durch Schnittstellen und Polymorphie erreicht.

- Liskov-Substitutionsprinzip (LSP):Objekte einer Oberklasse sollten durch Objekte ihrer Unterklassen ersetzt werden können, ohne die Anwendung zu beschädigen. Wenn eine Unterklasse unerwartet reagiert, wenn sie anstelle der Elternklasse verwendet wird, ist die Hierarchie fehlerhaft.

- Schnittstellen-Segregationsprinzip (ISP):Clients sollten nicht gezwungen werden, auf Methoden zu verweisen, die sie nicht verwenden. Große, monolithische Schnittstellen sollten in kleinere, spezifische aufgeteilt werden. Dadurch wird die Kopplung zwischen Komponenten reduziert.

- Prinzip der Abhängigkeitsinversion (DIP):Hochlevel-Module sollten nicht von Niveau-Modulen abhängen. Beide sollten von Abstraktionen abhängen. Dadurch wird das System entkoppelt, was eine einfachere Testbarkeit und den Austausch von Implementierungen ermöglicht.

2. Kopplung und Kohäsion 🔗

Diese beiden Metriken sind die direktesten Indikatoren für die Gesundheit des Designs. Sie sind invers miteinander verknüpft; im Allgemeinen nimmt die Kohäsion zu, wenn die Kopplung abnimmt.

- Kopplung:Der Grad der Wechselwirkung zwischen Softwaremodulen. Geringe Kopplung ist wünschenswert. Das bedeutet, dass Änderungen in einem Modul keine Änderungen in einem anderen erfordern. Hohe Kopplung erzeugt ein Netzwerk von Abhängigkeiten, das das Refactoring riskant macht.

- Kohäsion:Der Grad, zu dem Elemente innerhalb eines Moduls zusammengehören. Hohe Kohäsion bedeutet, dass eine Klasse oder ein Modul eine gut definierte, einzige Aufgabe erfüllt. Geringe Kohäsion deutet darauf hin, dass eine Klasse zu viele unzusammenhängende Aufgaben erfüllt, was oft ein Zeichen für das „God Class“-Anti-Muster ist.

Wichtige Metriken für die quantitative Analyse 📊

Während Prinzipien qualitative Anleitung bieten, liefern Metriken quantitative Daten. Statische Analysetools berechnen diese Werte oft, um potenzielle Problemfelder hervorzuheben. Nachfolgend finden Sie die relevantesten Metriken für die objektorientierte Bewertung.

| Metrik | Was misst es | Gewünschter Zustand | Auswirkung |

|---|---|---|---|

| Zyklomatische Komplexität | Anzahl unabhängiger Pfade durch den Code | Niedrig (z. B. < 10) | Hohe Komplexität erhöht den Aufwand für Tests und das Risiko von Fehlern. |

| Tiefe des Vererbungsbaums (DIT) | Anzahl der Vorfahren einer Klasse | Niedrig (z. B. < 4) | Tiefe Bäume machen das Verständnis des Verhaltens schwierig. |

| Anzahl der Nachkommen (NOC) | Anzahl der Unterklassen, die von einer Klasse erben | Variabel | Zu wenige können auf verpasste Abstraktion hindeuten; zu viele können auf Überingenieurwesen hindeuten. |

| Antwort für eine Klasse (RFC) | Anzahl der Methoden, die auf einem Objekt aufgerufen werden können | Niedrig bis moderat | Hoher RFC deutet darauf hin, dass die Klasse zu viel tut. |

| Gewichtete Methoden pro Klasse (WMC) | Summe der Komplexität aller Methoden in einer Klasse | Niedrig | Gibt an, wie schwierig die Klasse zu verstehen und zu testen ist. |

Beim Überprüfen dieser Metriken ist der Kontext König. Ein hoher WMC kann für ein komplexes Domänenmodell akzeptabel sein, während für einen einfachen Datencontainer ein niedriger WMC erwartet wird. Ziel ist es, Ausreißer zu identifizieren, die sich signifikant vom Durchschnitt innerhalb des Projekts unterscheiden.

Erkennen von Code-Gerüchen 🚨

Code-Gerüche sind oberflächliche Indikatoren für tiefere Probleme im Design. Sie sind keine Fehler, deuten aber darauf hin, dass das Design beginnt, sich zu verschlechtern. Die frühzeitige Erkennung dieser Muster ermöglicht eine proaktive Refaktorisierung.

- Lange Methode: Eine Funktion, die zu groß ist, um sie leicht zu verstehen. Sie sollte in kleinere, benannte Methoden aufgeteilt werden.

- Große Klasse: Eine Klasse mit zu vielen Verantwortlichkeiten. Es ist oft ein Zeichen dafür, dass das SRP verletzt wurde.

- Abweichende Änderungen: Eine Klasse, die aus vielen unterschiedlichen Gründen geändert wird. Dies deutet auf mangelnde Kohäsion hin.

- Funktionsneid: Eine Methode, die mehr Daten aus einer anderen Klasse als aus ihrer eigenen Klasse verwendet. Die Methode sollte wahrscheinlich der Klasse gehören, die sie beobachtet.

- Datenklumpen: Gruppen von Daten, die immer zusammen auftreten. Diese sollten in ein eigenes Objekt oder eine Struktur zusammengefasst werden.

- Parallele Vererbungshierarchien: Wenn Sie einer Hierarchie eine Unterklasse hinzufügen, müssen Sie auch eine andere hinzufügen. Dies erzeugt eine enge Kopplung zwischen Klassenhierarchien.

Refactoring-Strategien zur Verbesserung 🔧

Sobald eine Bewertung Probleme identifiziert hat, ist der nächste Schritt die Verbesserung. Refactoring ist der Prozess, die interne Struktur eines Software-Systems zu verändern, ohne dessen äußeres Verhalten zu beeinflussen. Es ist das primäre Werkzeug zur Aufrechterhaltung der Designqualität im Laufe der Zeit.

Häufige Refactoring-Techniken

- Methode extrahieren: Nehmen Sie einen Codeabschnitt innerhalb einer Methode und wandeln Sie ihn in eine neue Methode um. Dadurch wird Duplizierung reduziert und die Lesbarkeit verbessert.

- Klasse extrahieren: Verschieben Sie einige Felder und Methoden in eine neue Klasse. Dadurch werden Anliegen getrennt und die Klassengröße reduziert.

- Methode nach oben ziehen: Verschieben Sie eine Methode von einer Unterklasse in eine Oberklasse. Dadurch wird Code-Wiederverwendung gefördert und das Liskov-Substitutionsprinzip eingehalten.

- Bedingte Logik durch Polymorphie ersetzen: Anstatt

if/elseAnweisungen zur Behandlung verschiedener Typen zu verwenden, erstellen Sie spezifische Methoden in Unterklassen. Dies unterstützt das Open/Closed-Prinzip. - Parameterobjekt einführen: Parameter, die oft zusammen auftreten, in ein einzelnes Objekt zusammenfassen. Dadurch werden Methodensignaturen vereinfacht.

Kompromisse und kontextabhängige Entscheidungen ⚖️

Design ist selten schwarz-weiß. Es gibt oft Kompromisse zwischen Leistung, Lesbarkeit und Komplexität. Ein perfekt entkoppelter Entwurf könnte Overhead verursachen, der die Leistung beeinträchtigt. Ein stark optimierter Entwurf könnte schwer verständlich sein.

- Leistung vs. Wartbarkeit: Manchmal führt die strikte Einhaltung von Designprinzipien zu zusätzlichen Abstraktionsebenen. In leistungsrelevanten Bereichen kann es akzeptabel sein, diese Regeln zu lockern, um eine direkte Ausführung zu ermöglichen.

- Komplexität vs. Einfachheit: Zu starkes Vereinfachen eines Domänenmodells kann wichtige Geschäftsregeln verbergen. Umgekehrt führt ein übermäßiges Engineering eines einfachen Skripts zu einer unnötigen Wartungsbelastung.

- Zeit vs. Qualität: Bei engen Terminvorgaben könnten Teams technische Schulden eingehen. Der Bewertungsprozess sollte diese Schulden verfolgen und Zeit zur Rückzahlung planen, bevor sie sich vergrößern.

Ein praktischer Überprüfungs-Checklist ✅

Bei der Durchführung einer Designüberprüfung verwenden Sie die folgende Checkliste, um sicherzustellen, dass alle Aspekte der Qualität abgedeckt sind. Dies hilft dabei, den Bewertungsprozess innerhalb des Teams zu standardisieren.

- Verantwortung: Hat jede Klasse einen klaren, eindeutigen Zweck?

- Abhängigkeiten: Werden Abhängigkeiten injiziert oder lokal erstellt? Sind sie minimiert?

- Schnittstellen:Sind die Schnittstellen spezifisch auf die Bedürfnisse der Clients abgestimmt?

- Vererbung:Wird Vererbung zur Wiederverwendung von Verhalten und nicht nur zur Wiederverwendung von Implementierungsdetails verwendet?

- Zustand:Ist der Zustand gekapselt? Ist er nur dort veränderbar, wo erforderlich?

- Dokumentation:Ist das Designziel durch Kommentare oder Dokumentation klar erkennbar?

- Testbarkeit:Können die Komponenten isoliert getestet werden?

- Konsistenz:Folgt der Namensgebung und die Struktur den etablierten Konventionen des Projekts?

Der menschliche Faktor im Design 👥

Automatisierte Tools und Metriken sind hilfreich, können aber nicht alles erfassen. Der menschliche Faktor spielt eine entscheidende Rolle bei der Gestaltung der Designqualität. Ein technisch perfektes Design könnte scheitern, wenn das Team es nicht verstehen kann.

- Team-Wissen:Ein Design sollte die bestehenden Fähigkeiten des Teams nutzen. Die unnötige Einführung komplexer Muster kann das Onboarding verlangsamen.

- Kommunikation:Gutes Design fördert die Kommunikation. Klare Grenzen zwischen Modulen ermöglichen es verschiedenen Teams, parallel zu arbeiten, ohne sich gegenseitig zu behindern.

- Feedback-Schleifen:Regelmäßige Code-Reviews sind essenziell. Sie bieten eine Plattform, um Designentscheidungen zu diskutieren und Wissen zu teilen.

Überwachung der Design-Gesundheit im Laufe der Zeit 📈

Die Bewertung ist kein einmaliger Vorgang. Software entwickelt sich weiter, und die Designqualität kann abnehmen. Die kontinuierliche Überwachung stellt sicher, dass das System gesund bleibt.

- Integration statischer Analyse: Integrieren Sie Analysetools in die Build-Pipeline, um Verstöße frühzeitig zu erkennen.

- Code-Review-Richtlinien: Fordern Sie Designbesprechungen für wesentliche Änderungen an.

- Refactoring-Sprints:Weisen Sie spezifische Zeit zur Behebung technischer Schulden und zur Verbesserung der Struktur zu.

- Dokumentationsaktualisierungen: Stellen Sie sicher, dass Architekturdiagramme aktualisiert werden, wenn sich das System ändert.

Schlussfolgerung zu Bewertungspraktiken 🎯

Die Bewertung objektorientierter Designs ist eine fortlaufende Disziplin. Sie erfordert ein Gleichgewicht aus theoretischem Wissen, praktischen Metriken und menschlicher Urteilskraft. Indem Teams sich auf Prinzipien wie SOLID konzentrieren, Kopplung und Kohäsion überwachen und auf Code-Schimmel achten, können sie Systeme schaffen, die der Zeit standhalten. Das Ziel ist nicht Perfektion, sondern kontinuierliche Verbesserung und Widerstandsfähigkeit gegenüber Veränderungen.

Denken Sie daran, dass das beste Design das ist, das das Problem effektiv löst, während es für die Personen verständlich bleibt, die es warten müssen. Setzen Sie Klarheit und Einfachheit an erster Stelle, und lassen Sie die Metriken diese Ziele unterstützen, anstatt sie vorzugeben.