在複雜系統中,效率並非總是在問題發生前顯而易見。當流程停滯、資料延遲或吞吐量下降時,根本問題通常不在資料儲存或運算本身,而在資訊的流動過程。資料流分析提供了一種結構化的方法,用以視覺化資訊在系統中的移動方式,使識別摩擦點變得更容易。透過繪製這些資料流,團隊能夠精確定位容量超載或無謂延遲累積的位置。 🧭

此方法需要對系統架構有清晰的理解,且不依賴專有工具。目標是建立一個邏輯框架,以揭示效率低下的問題。無論是管理軟體流程、製造線,還是行政工作流程,這些原則都保持一致。識別這些限制因素,可促使針對性的干預措施,從而實現速度與可靠性的可衡量提升。 ⚙️

理解資料流圖的基礎 🗺️

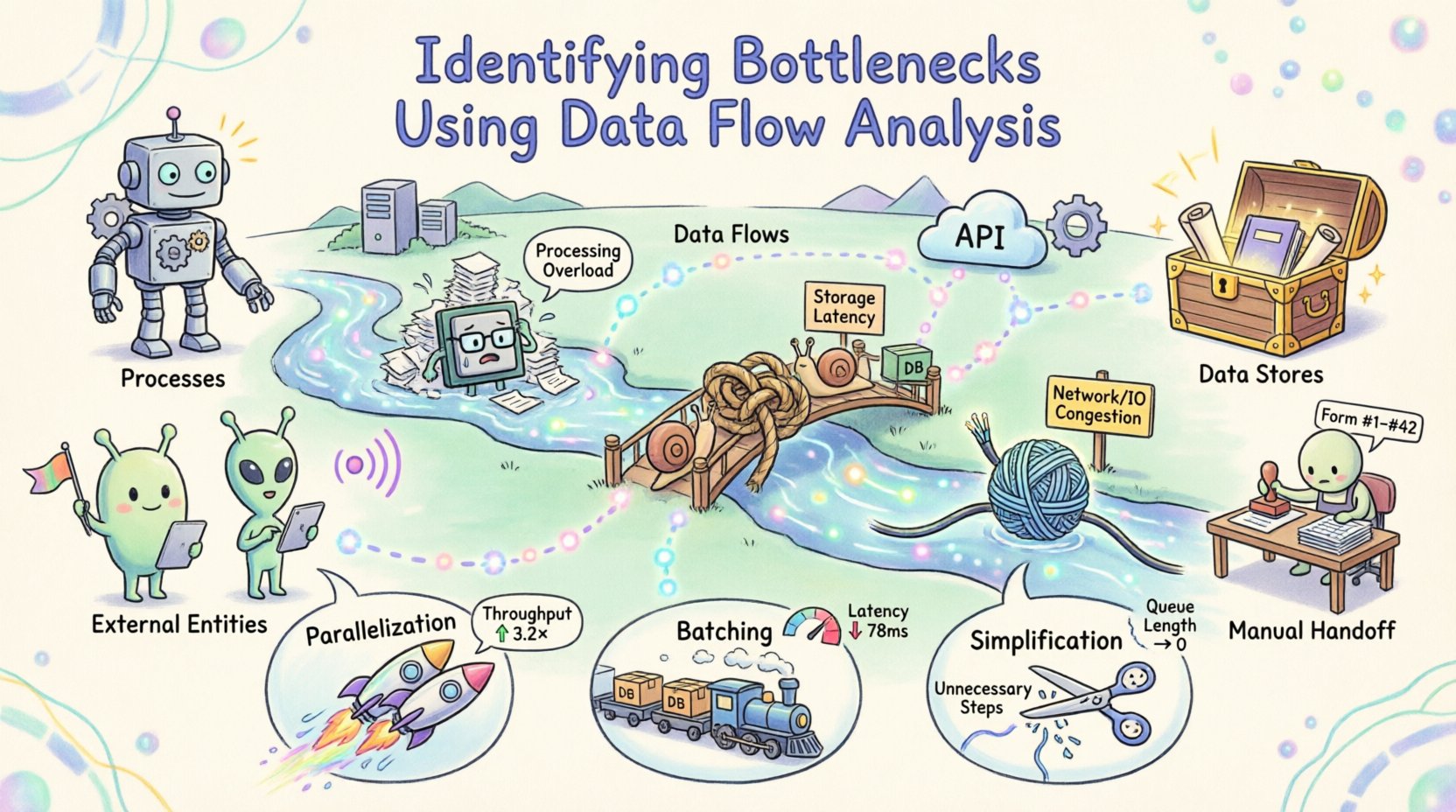

在定位瓶頸之前,必須先理解地圖。資料流圖(DFD)是資訊系統中資料流動的圖形化表示。它專注於資料的來源、去向以及其變化方式。與描述控制邏輯的流程圖不同,DFD強調資料元素的移動與轉換。

標準DFD中包含四個主要元件:

- 處理程序:將輸入資料轉換為輸出資料的轉換過程。通常以圓形或圓角矩形表示。

- 資料儲存:資料暫存以供後續使用的地點,例如資料庫或檔案。

- 外部實體:系統邊界以外的來源或目的地,例如使用者或其他系統。

- 資料流:資料在各元件之間移動的路徑。

建立高階圖表可確立範圍。低階圖表則進一步深入探討特定流程。這種層級結構使分析人員能以不同細節層級檢視系統。若在整體層級出現延遲,放大檢視即可揭示造成延遲的具體流程或資料傳輸。 🔍

系統瓶頸的構成 🚦

瓶頸是系統中任何資料流受阻的點,導致資料累積或延遲。在資料流分析的脈絡中,瓶頸會以幾種明顯的方式呈現。辨識出限制類型,是解決問題的第一步。

| 瓶頸類型 | 描述 | 典型症狀 |

|---|---|---|

| 處理 | 運算或邏輯處理時間超過輸入資料流所能支援的範圍。 | 處理前的佇列不斷累積;CPU或記憶體使用率急劇上升。 |

| 儲存 | 讀取或寫入資料庫或檔案系統的資料速度緩慢。 | 資料取得期間延遲增加;交易時間波動極大。 |

| 網路/輸入輸出 | 元件之間的傳輸速度受限於頻寬或延遲。 | 發生逾時;大規模資料傳輸經常中斷。 |

| 人力 | 在應當自動化的環節卻需要人工介入。 | 任務等待核准;因疲勞或複雜性導致錯誤發生。 |

理解這些類別有助於優先處理問題。網路限制可能需要基礎設施變更,而處理限制可能需要演算法優化。若缺乏此區分,努力可能被誤導至系統並未受限制的領域。🛠️

識別方法論 🔎

識別瓶頸並非一次性的事件,而是一項系統性的調查。以下步驟概述了一種穩健的方法,用於分析資料流並定位限制因素。

1. 繪製現狀圖

首先,記錄現有的架構。不要依賴記憶或假設。應訪談相關利益方並審閱文件,以捕捉實際的資訊流動。建立一張 Level 0 圖,顯示系統邊界與外部互動。接著,建立 Level 1 圖,將主要流程細分。確保每一個資料流都有明確的輸入與輸出。

2. 定義衡量指標

視覺地圖是定性的。要找出瓶頸,需要定量資料。為每個流程與資料流選擇關鍵績效指標(KPI)。相關指標包括:

- 吞吐量: 每單位時間處理的資料量。

- 延遲: 資料從來源傳送到目的地所花的時間。

- 使用率: 資源處於活躍狀態的時間百分比。

- 隊列長度: 等待處理的項目數量。

在具有代表性的期間內收集這些資料,可揭示出模式。某個流程平均看起來很快,但在高峰負載期間可能出現顯著的尖峰。這些尖峰往往是瓶頸藏身之處。📉

3. 分析資料轉換

檢視流程之間的連接。尋找會分支成多條路徑或由多個來源合併的資料流。合併點通常會造成競爭。若三個資料流同時輸入同一個處理器,該處理器必須承擔合併後的負載。若容量未相應擴展,就會形成積壓。

同樣地,檢查是否存在迴圈。資料反覆循環經過同一個流程,通常表示需要重做或錯誤處理。過度的迴圈會消耗資源卻不增加價值。追蹤這些迴圈,以判斷其是否必要,或是設計不良所致。🔄

4. 與資源使用情況相關聯

將資料流指標與系統資源對應起來。高資料流體積應與高資源使用率相關。若某個特定資料流顯示高延遲,但其他地方資源使用率卻很低,問題可能僅限於該路徑。反之,若所有流程同時變慢,問題可能是系統性的,例如共享資料庫鎖或網路擁塞。

使用監控工具同時追蹤資源消耗與資料流。這種關聯有助於區分邏輯瓶頸(設計不良)與物理瓶頸(硬體限制)。⚖️

量化限制因素的影響 📊

一旦識別出潛在的瓶頸,就必須量化其影響。這一步驟確保資源被分配給最關鍵的問題。並非所有延遲都同等重要。使用者介面的延遲可能比背景報表產生的延遲更具破壞性。

計算延遲的成本。這包括估算每次交易所損失的時間,並乘以交易量。例如,若某流程額外耗時 100 毫秒,且每小時處理 10,000 筆交易,則總損失時間將非常顯著。若此延遲影響使用者體驗,商業成本將更高。

考慮其連鎖效應。管道起始處的延遲可能向下傳播。若第一步延遲,所有後續步驟都會被推遲。這會放大總體影響。識別根本原因可避免只處理症狀。修復第一步,通常能自動解決下游的延遲問題。🌊

優化策略 🛠️

在識別並量化瓶頸後,重點轉向優化。策略取決於限制的性質。主要有三個可操作的手段:平行化、批次處理與簡化。

平行化

若某流程受限於運算能力,將工作分散到多個資源上可提升吞吐量。這通常適用於獨立任務。若資料流允許拆分,則應均勻分配負載。確保同步開銷不會抵消所帶來的效益。當任務之間不依賴彼此的即時輸出時,平行化效果最佳。🚀

批次處理

若限制與 I/O 或網路延遲有關,以批次方式處理資料,通常比逐一處理更有效率。這可減少開啟與關閉連接的開銷。然而,批次處理會為單一項目引入延遲。需在吞吐量提升與使用者可接受的延遲之間取得平衡。📦

簡化

通常,最有效的優化方式是移除不必要的步驟。審查資料流中是否有重複的轉換。若資料從一種格式轉換為另一種格式,再轉回原格式,中間步驟可能被移除。簡化邏輯以減少處理時間。流程中每增加一個步驟,就會引入潛在的失敗點與延遲。✂️

持續監控與迭代 🔄

優化並非終點。系統會持續演進,隨著流量模式的變化,新的瓶頸也會不斷出現。一旦初步分析完成並實施改善措施,循環便會重新開始。建立定期檢視資料流的習慣。

為先前定義的指標設定警示。若吞吐量下降或延遲突然上升,立即啟動調查。維護資料流程圖(DFD)的文件紀錄。隨著系統的變更,同步更新圖示。過時的圖譜會導致錯誤的假設與無效的努力。 📝

鼓勵持續改進的文化。團隊應被賦予權力,報告日常工作中發現的低效率問題。一線使用者經常能察覺高階指標所忽略的瓶頸。他們的反饋對於精進分析至關重要。 👥

案例研究:通用工作流程優化 🏭

假設有一個訂單處理系統在尖峰時段出現延遲。初步分析顯示,訂單驗證步驟耗時過長。資料流程圖(DFD)顯示,驗證需對三個不同的外部系統進行獨立檢查。

透過分析流程,團隊發現這些檢查是依序執行的。將設計改為並行執行檢查,使總驗證時間減少60%。資料流程圖也隨之更新以反映此新結構。監控結果顯示,佇列清除速度加快,系統在尖峰負載下無需人工干預即可順利運作。此案例說明,流程結構的調整能立即產生顯著成效。 ✅

永續效率的最佳實務 🌱

為維持系統健康,請遵循以下指引:

- 保持圖示即時更新: 一份過時的地圖,比沒有地圖更糟糕。

- 關注流程,不僅僅是功能: 確保資料流暢移動,而不僅僅是功能正常運作。

- 記錄每一項數據: 若未被衡量,就無法改善。

- 定期檢視: 計畫定期審查資料架構。

- 記錄假設: 記錄特定流程設計成此樣貌的原因,以利未來故障排除。

將資料流視為關鍵資產,組織便能確保系統始終具備回應力與可靠性。識別瓶頸的過程,並非尋找錯誤,而是深入理解系統。這種理解將帶來韌性與效能。 🛡️

關於資料流完整性之終極思考 🧩

任何系統的效率都取決於資訊的順暢流動。當資料遭遇阻力時,整個運作便會減緩。資料流分析提供了一個清晰的視角,用以察覺阻力發生的位置。透過繪製、衡量與調整流程,團隊能消除摩擦,提升效能。

本文所述的技術提供了一套永續優化的架構。它需要紀律與細節關注,但回報是系統能在壓力下持續穩定運作。隨著資料量不斷增長,管理流程的能力變得日益關鍵。掌握此項紀律,能確保架構的長久與可靠。 🏆