Em sistemas complexos, a eficiência nem sempre é evidente até que ocorra uma desaceleração. Quando processos param, os dados atrasam ou a taxa de throughput diminui, o problema subjacente geralmente reside no movimento da informação, e não no armazenamento ou na computação em si. A análise de fluxo de dados fornece um método estruturado para visualizar como a informação se move por um sistema, tornando mais fácil identificar onde surgem atritos. Ao mapear esses fluxos, as equipes conseguem localizar com precisão os pontos onde a capacidade é ultrapassada ou onde atrasos desnecessários se acumulam. 🧭

Esta abordagem exige uma compreensão clara da arquitetura do sistema sem depender de ferramentas proprietárias. O objetivo é estabelecer uma estrutura lógica que revele ineficiências. Seja no gerenciamento de uma pipeline de software, uma linha de produção ou um fluxo administrativo, os princípios permanecem consistentes. Identificar essas restrições permite intervenções direcionadas que geram melhorias mensuráveis em velocidade e confiabilidade. ⚙️

Compreendendo as Fundamentações dos Diagramas de Fluxo de Dados 🗺️

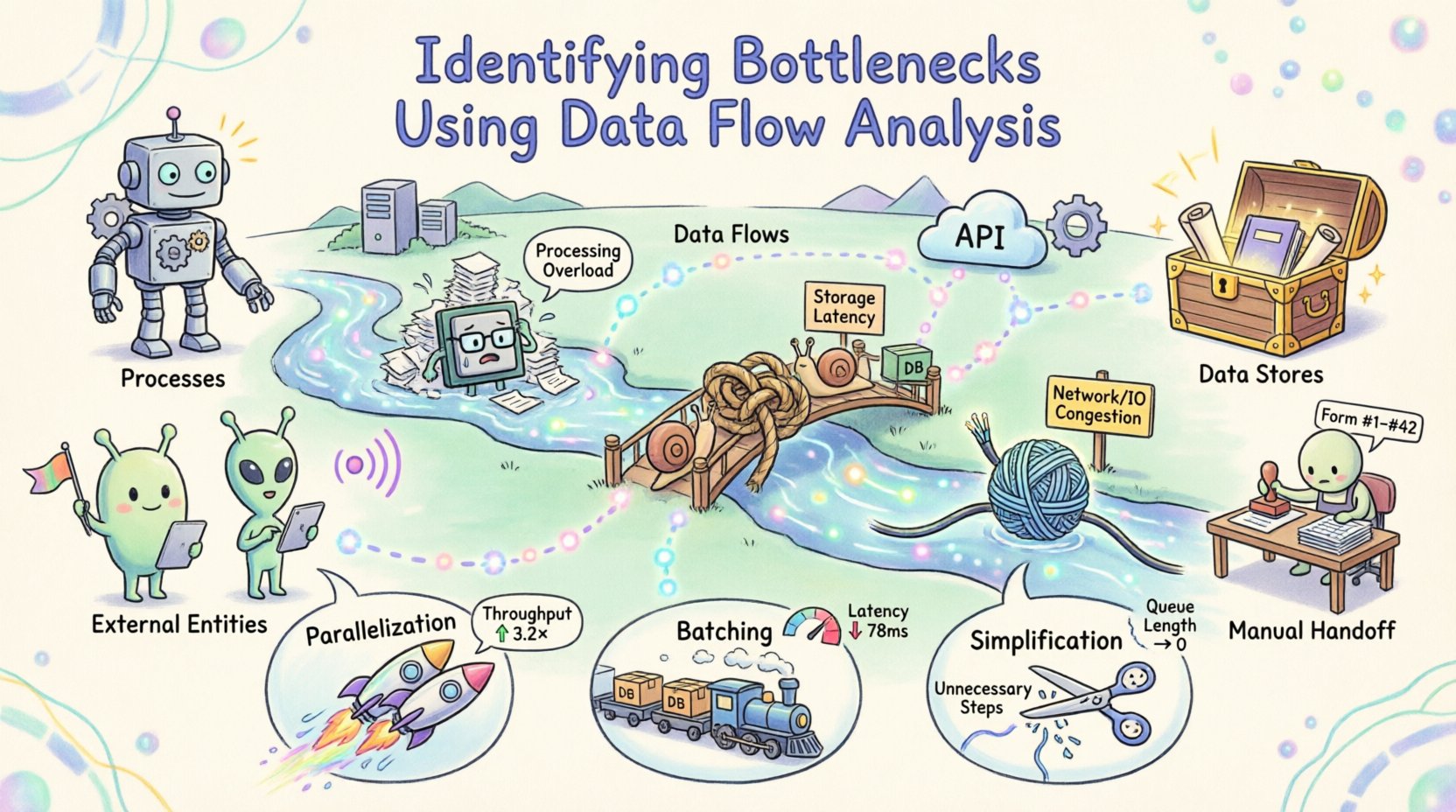

Antes de localizar um estreitamento, é necessário entender o mapa. Um Diagrama de Fluxo de Dados (DFD) é uma representação gráfica do fluxo de dados por um sistema de informação. Ele foca em onde os dados vêm, para onde vão e como mudam. Diferentemente dos fluxogramas que representam a lógica de controle, os DFDs enfatizam o movimento e a transformação dos elementos de dados.

Existem quatro componentes principais em um DFD padrão:

- Processos: Transformações que convertem dados de entrada em dados de saída. Geralmente são representados por círculos ou retângulos arredondados.

- Armazenamentos de Dados: Locais onde os dados são armazenados para uso posterior, como bancos de dados ou arquivos.

- Entidades Externas: Fontes ou destinos fora da fronteira do sistema, como usuários ou outros sistemas.

- Fluxos de Dados: Os caminhos pelos quais os dados se movem entre os componentes.

Criar um diagrama de alto nível estabelece o escopo. Um diagrama de nível inferior então investiga processos específicos. Essa hierarquia permite que analistas examinem o sistema em diferentes níveis de granularidade. Se um atraso ocorrer no nível macro, ampliar o foco revela o processo ou transferência específico que causa o atraso. 🔍

A Anatomia de um Estreitamento no Sistema 🚦

Um estreitamento é qualquer ponto em um sistema onde o fluxo de dados é restrito, causando um acúmulo ou atraso. No contexto da análise de fluxo de dados, os estreitamentos se manifestam de várias formas distintas. Reconhecer o tipo de restrição é o primeiro passo para a resolução.

| Tipo de Estreitamento | Descrição | Sintomas Comuns |

|---|---|---|

| Processamento | Computação ou lógica leva mais tempo do que a corrente de dados de entrada pode suportar. | Filas se acumulam antes do processo; picos de uso elevado de CPU ou memória. |

| Armazenamento | A leitura ou escrita de dados em um banco de dados ou sistema de arquivos é lenta. | A latência aumenta durante a recuperação de dados; os tempos de transação variam amplamente. |

| Rede/Entrada/Saída | A velocidade de transferência entre componentes é limitada pela largura de banda ou pela latência. | Ocorrem timeouts; transferências de grandes volumes de dados param com frequência. |

| Humano | Intervenção manual é necessária onde a automação deveria existir. | Tarefas aguardam aprovação; erros ocorrem devido à fadiga ou à complexidade. |

Compreender essas categorias ajuda a priorizar as correções. Uma limitação de rede pode exigir mudanças na infraestrutura, enquanto um limite de processamento pode precisar de otimização algorítmica. Sem essa distinção, os esforços podem ser desviados para áreas que não restringem o sistema. 🛠️

Metodologia para Identificação 🔎

Identificar gargalos não é um evento único, mas uma investigação sistemática. Os seguintes passos descrevem uma abordagem sólida para analisar fluxos de dados e localizar restrições.

1. Mapeie o Estado Atual

Comece documentando a arquitetura existente. Não dependa da memória ou de suposições. Interview stakeholders e revise documentação para capturar o fluxo real de informações. Crie um diagrama de Nível 0 que mostre a fronteira do sistema e as interações externas. Em seguida, crie diagramas de Nível 1 que dividam os principais processos. Certifique-se de que cada fluxo de dados tenha uma entrada e saída definidas.

2. Defina Métricas para Medição

Mapas visuais são qualitativos. Para encontrar gargalos, você precisa de dados quantitativos. Selecione indicadores-chave de desempenho (KPIs) para cada processo e fluxo de dados. Métricas relevantes incluem:

- Throughput: A quantidade de dados processados por unidade de tempo.

- Latência: O tempo necessário para os dados viajarem da fonte até o destino.

- Utilização: A porcentagem de tempo em que um recurso está ativo.

- Comprimento da Fila: O número de itens aguardando processamento.

Coletar esses dados durante um período representativo revela padrões. Um processo pode parecer rápido em média, mas apresentar picos significativos durante cargas máximas. Esses picos são frequentemente onde o gargalo está escondido. 📉

3. Analise as Transições de Dados

Examine as conexões entre processos. Procure fluxos de dados que se ramifiquem em múltiplos caminhos ou que se fundam a partir de múltiplas fontes. Pontos de fusão frequentemente geram contenção. Se três fluxos alimentam um único processador, esse processador deve lidar com a carga combinada. Se a capacidade não for escalada adequadamente, uma fila de espera se forma.

Da mesma forma, verifique loops. Dados que retornam repetidamente por um processo indicam reprocessamento ou tratamento de erros. Laços excessivos consomem recursos sem agregar valor. Rastreie esses loops para determinar se são necessários ou resultado de um mau design. 🔄

4. Correlacione com o Uso de Recursos

Mapeie as métricas de fluxo de dados contra os recursos do sistema. Um volume alto de fluxo de dados deve correlacionar-se com alto uso de recursos. Se um fluxo específico apresenta alta latência, mas baixo uso de recursos em outras partes, o problema pode ser específico desse caminho. Por outro lado, se todos os processos diminuírem simultaneamente, o problema pode ser sistêmico, como um bloqueio compartilhado em banco de dados ou congestionamento de rede.

Use ferramentas de monitoramento para acompanhar o consumo de recursos junto com o fluxo. Essa correlação ajuda a distinguir entre um gargalo lógico (mau design) e um gargalo físico (limites de hardware). ⚖️

Quantificando o Impacto das Restrições 📊

Uma vez identificado um possível gargalo, seu impacto deve ser quantificado. Esta etapa garante que os recursos sejam alocados para os problemas mais críticos. Nem todos os atrasos são iguais. Um atraso na interface do usuário pode ser mais prejudicial do que um atraso na geração de relatórios em segundo plano.

Calcule o custo do atraso. Isso envolve estimar o tempo perdido por transação e multiplicá-lo pelo volume de transações. Por exemplo, se um processo leva mais 100 milissegundos e processa 10.000 transações por hora, o tempo total perdido é significativo. Se esse atraso afeta a experiência do usuário, o custo para o negócio é ainda maior.

Considere o efeito em cadeia. Um atraso no início de uma pipeline pode se propagar para baixo. Se o primeiro passo for atrasado, todos os passos subsequentes são atrasados. Isso amplifica o impacto total. Identificar a causa raiz evita tratar apenas os sintomas. Corrigir o primeiro passo frequentemente resolve automaticamente os atrasos posteriores. 🌊

Estratégias para Otimização 🛠️

Com os gargalos identificados e quantificados, o foco muda para a otimização. A estratégia depende da natureza da restrição. Existem três principais alavancas a serem usadas: paralelização, agrupamento e simplificação.

Paralelização

Se um processo é limitado por computação, dividir o trabalho entre múltiplos recursos pode aumentar o throughput. Isso é frequentemente aplicável a tarefas independentes. Se o fluxo de dados permitir divisão, distribua a carga. Certifique-se de que a sobrecarga de sincronização não anule os ganhos. A paralelização funciona melhor quando as tarefas não dependem da saída imediata uma da outra. 🚀

Agrupamento

Se a restrição está relacionada à I/O ou à latência de rede, processar dados em lotes pode ser mais eficiente do que processar itens individuais. Isso reduz a sobrecarga de abrir e fechar conexões. No entanto, o agrupamento introduz latência para itens individuais. Equilibre o ganho de throughput com o atraso aceitável para o usuário final. 📦

Simplificação

Freqüentemente, a otimização mais eficaz é remover etapas desnecessárias. Revise o fluxo de dados em busca de transformações redundantes. Se os dados forem convertidos de um formato para outro e depois de volta, a etapa intermediária pode ser removida. Simplifique a lógica para reduzir o tempo de processamento. Cada etapa adicionada a um fluxo introduz pontos potenciais de falha e atraso. ✂️

Monitoramento Contínuo e Iteração 🔄

A otimização não é um destino final. Os sistemas evoluem, e novos gargalos surgem conforme os padrões de tráfego mudam. Uma vez que a análise inicial seja concluída e as melhorias implementadas, o ciclo começa novamente. Estabeleça uma rotina para revisar os fluxos de dados.

Configure alertas para as métricas definidas anteriormente. Se o throughput cair ou a latência aumentar abruptamente, dispare uma investigação. Mantenha a documentação dos DFDs atualizada. À medida que mudanças são feitas no sistema, atualize os diagramas. Mapas desatualizados levam a suposições incorretas e esforço desperdiçado. 📝

Incentive uma cultura de melhoria contínua. As equipes devem ser capacitadas para relatar ineficiências que encontram no trabalho diário. Usuários na linha de frente muitas vezes percebem gargalos que métricas de alto nível ignoram. Seu feedback é inestimável para aprimorar a análise. 👥

Estudo de Caso: Otimização de um Fluxo de Trabalho Genérico 🏭

Considere um cenário em que um sistema de processamento de pedidos apresentou atrasos durante os horários de pico. A análise inicial mostrou que a etapa de validação do pedido estava demorando demais. O DFD revelou que a validação exigia três verificações separadas contra diferentes sistemas externos.

Ao analisar o fluxo, a equipe percebeu que essas verificações ocorriam sequencialmente. Alterar o design para realizar essas verificações em paralelo reduziu o tempo total de validação em 60%. O diagrama de fluxo de dados foi atualizado para refletir essa nova estrutura. O monitoramento confirmou que a fila de pendências foi esvaziada mais rapidamente, e o sistema lidou com cargas de pico sem intervenção. Este exemplo demonstra como mudanças estruturais no fluxo geram resultados imediatos. ✅

Melhores Práticas para Eficiência Sustentável 🌱

Para manter um sistema saudável, siga estas diretrizes:

- Mantenha os Diagramas Atualizados: Um mapa desatualizado é pior do que nenhum mapa.

- Concentre-se no Fluxo, Não Apenas na Função: Garanta que os dados fluam suavemente, e não apenas que os recursos funcionem.

- Meça Tudo: Se não for medido, não pode ser melhorado.

- Revise Regularmente: Planeje auditorias periódicas da arquitetura de dados.

- Documente Suposições: Registre por que certos fluxos foram projetados de uma maneira específica para auxiliar na solução de problemas futuros.

Ao tratar o fluxo de dados como um ativo crítico, as organizações podem garantir que seus sistemas permaneçam responsivos e confiáveis. O processo de identificação de gargalos não se trata de encontrar falhas, mas de compreender profundamente o sistema. Essa compreensão leva à resiliência e ao desempenho. 🛡️

Pensamentos Finais sobre a Integridade do Fluxo de Dados 🧩

A eficiência em qualquer sistema depende do movimento suave da informação. Quando os dados encontram resistência, toda a operação desacelera. A análise de fluxo de dados oferece uma lente clara para identificar onde essa resistência ocorre. Ao mapear, medir e modificar o fluxo, as equipes podem eliminar atritos e melhorar o desempenho.

As técnicas descritas aqui fornecem uma estrutura para otimização sustentável. Exigem disciplina e atenção aos detalhes, mas o retorno é um sistema que se mantém consistente sob pressão. À medida que os volumes de dados crescem, a capacidade de gerenciar o fluxo torna-se cada vez mais crítica. Dominar essa disciplina garante longevidade e confiabilidade para a arquitetura. 🏆